Что самое сложное в работе оптимизатора? Это риторический вопрос.

Для любого профессионала: свободного специалиста или целой компании, вывести сайт по запросам в первую десятку – не проблема. Это не сложно для специалистов. Сложности начинаются, если сайт, в который уже вложены немалые средства за одни сутки выпадает из первой двадцатки.

В прошлой статье я рассказал Вам как оптимизировать сайт под поисковую систему Rambler. Теперь Вы узнаете более подробно про поисковую оптимизацию в целом.

И все вложения клиента аннулируются из-за смены поискового алгоритма, крошечного новшества учета внешних факторов? Раньше поисковые машины были так разумны. И Всемирная Сеть была менее глобальной, и пользователь решал задачу поиска информации, просто перебирая дословные совпадения. Тогда было можно за короткое время посмотреть все сайты на нужную тему. Но это было давно.

Затем пришли первые оптимизаторы. Тогда они назывались как-то по-другому. Они пришли, и работа поисковиков-динозавров, устаревших и ископаемых машин- была парализована. Обманывать кондовые алгоритмы было легко до слез, чем и пользовались новоявленные бизнесмены. Но пользователи поисковиков, не оценили это новшество. И началась беспрецедентная гонка оптимизаторов и поисковиков – гонка-игра, выгодная для обеих сторон. Выгодная всем, кроме владельцев ресурсов.

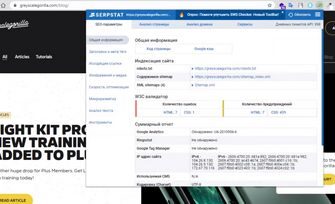

Найти контент, который по максимуму соответствует поисковому запросу ( с информацией, необходимой для пользователя поисковика) – задача, с разными решениями. Можно следовать за оптимизаторами – нашими предками, основная цель которых – обмануть поисковые машины и «учить» поисковые алгоритмы уметь отличать методы «накруток». Многие методы поисковой оптимизации, которые называются белыми постепенно сереют, а потом чернеют. Можно подключить факторы правил оптимизации внешних показателей, таких, как индекс цитируемости, позволяющие правильно оценить «авторитетность» данного ресурса. Это тоже делали и будут делать всегда. Проблема заключается совсем в другом: и разработчики и оптимизаторы поисковых систем, понимают, что это может позволить урегулировать какие-то небольшие частные проблемы, открывая пути для новых. Это явление выглядело совершенно очевидным и предсказуемым.

Многие специалисты, очень обеспокоились, когда стало очевидно, что Google полностью поменял алгоритмы ранжирования. Сайты с хорошим контентом, быстро полезли вверх, смещая вниз удачно оптимизированные, ресурсы, обогащенные внешними ссылками. Это заметили все, кто хоть как-то имел отношение к данному вопросу. Заметили, но ничего не смогли изменить.. Google не дает возможности для существования «продажного» трафика. Или дает, но не сопоставимую затратам для оптимизации под прогрессирующий алгоритм.

Google применяет алгоритмы, которые, вынуждены копировать программисты других поисковых машин, например, Яндекса. «Падение» в Яндексе сайтов с высокими показателями цитируемости не стало неожиданностью для оптимизаторов. Поисковые алгоритмы постоянно совершенствуются и уже почти не нуждаются в учете разных факторов.