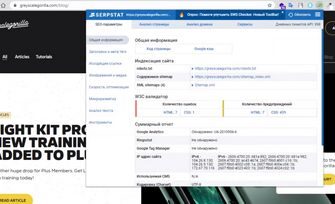

Часто встречается ситуация, когда вебмастеру нужно убрать с сайта уже проиндексированные страницы. Происходит это оттого, что информация устаревает или потому, что меняется тематика сайта и прежние статьи уже не актуальны.

Существует несколько способов удалить страницу из индекса, давайте рассмотрим их поподробнее.

• Страница 404

Это обычное удаление веб страницы. Однако вебмастеру необходимо проследить, чтобы пользователь получал уведомление о том, что данной страницы не существует. Способ этот довольно долгий, поисковый бот должен как минимум дважды зайти на страницу, увидеть ошибку 404 и только тогда страница будет исключена из индексации.

• Ручное удаление страницы

Самый надежный способ – это удалить страницу вручную. Это достаточно долгий метод, так как придется удалять только по одной странице за раз.

Для Яндекса: webmaster.yandex.ru/delurl.xml

Для Google: google.com/webmasters/tools/home?hl=ru

Но при этом следует помнить, что страница должна содержать ошибку 404 или быть прописана в robots.txt. Только после этого панель вебмастера удалит страницу из индекса.

• Robots.txt

Часто используется и файл robots.txt, с помощью которого вебмастер закрывает некоторые страницы сайта от индексации. Через непродолжительное время страница перестанет индексироваться. Для поисковиков прописывается следующее:

User-Agent: *

Disallow: /post.html # закрытие страницы post.html

Однако это не совсем надежный способ, так как на давно проиндексированные страницы могут вести внешние ссылки и в этом случае они будут видны пользователям.

• Robots в качестве мета-тега

В этом случае вебмастер работает не с файлом robots.txt, а со страницей, где в коде между head и /head он должен прописать: meta name=”robots” content=”noindex,nofollow”. Этот способ особенно хорош, когда заранее известно, что эта страница не должна индексироваться, но имеет один изъян – динамические сайты, использующие шаблонное подключение модулей в этом случае могут закрыть от индексации все страницы ресурса.

• X-Robots-Tag

Как альтернатива вышеприведенным способам, может быть использован тег X-Robots. Тег прописывается в HTTP заголовке: X-Robots-Tag: noindex, nofollow. Но при этом нужно быть уверенным, что на веб-странице нет ничего подозрительного, так как это прием «черного SEO», с помощью которого от поисковиков прячут страницы со ссылками.